Point clé

La gouvernance IA pour les équipes produit repose sur cinq piliers : journalisation des entrées/sorties, détection des biais, pistes d'audit, contrôles de confidentialité et versionnage des modèles. Adaptez chaque mesure au niveau de risque de votre fonctionnalité et automatisez le maximum.

La plupart des conversations sur la gouvernance IA partent du mauvais pied. Elles commencent par la réglementation, les cadres de référence et les documents de politiques rédigés par des gens qui n’ont jamais livré une fonctionnalité IA en production. Les équipes produit décrochent. Normal.

La gouvernance n’est pas un exercice de conformité greffé à votre processus de mise en production. Pour les équipes d’ingénierie et de produit dans les entreprises SaaS, la gouvernance désigne l’ensemble des décisions que vous prenez sur le comportement de vos fonctionnalités IA quand personne ne regarde. Ce qui se passe quand le modèle hallucine. Ce qui se passe quand un utilisateur colle des renseignements personnels dans un prompt. Ce qui se passe quand l’équipe juridique d’un client demande pourquoi votre système a fait telle recommandation. Ce sont des problèmes d’ingénierie produit, pas des problèmes juridiques.

Cet article est un guide pratique pour les directeurs techniques et les responsables d’ingénierie dans des entreprises SaaS de 50 à 200 personnes qui livrent des fonctionnalités IA. Pas de gabarits de politiques. Pas de listes de vérification de conformité. Juste les éléments concrets que votre équipe doit construire, surveiller et documenter.

À quoi ressemble la gouvernance IA au niveau de l’équipe produit?

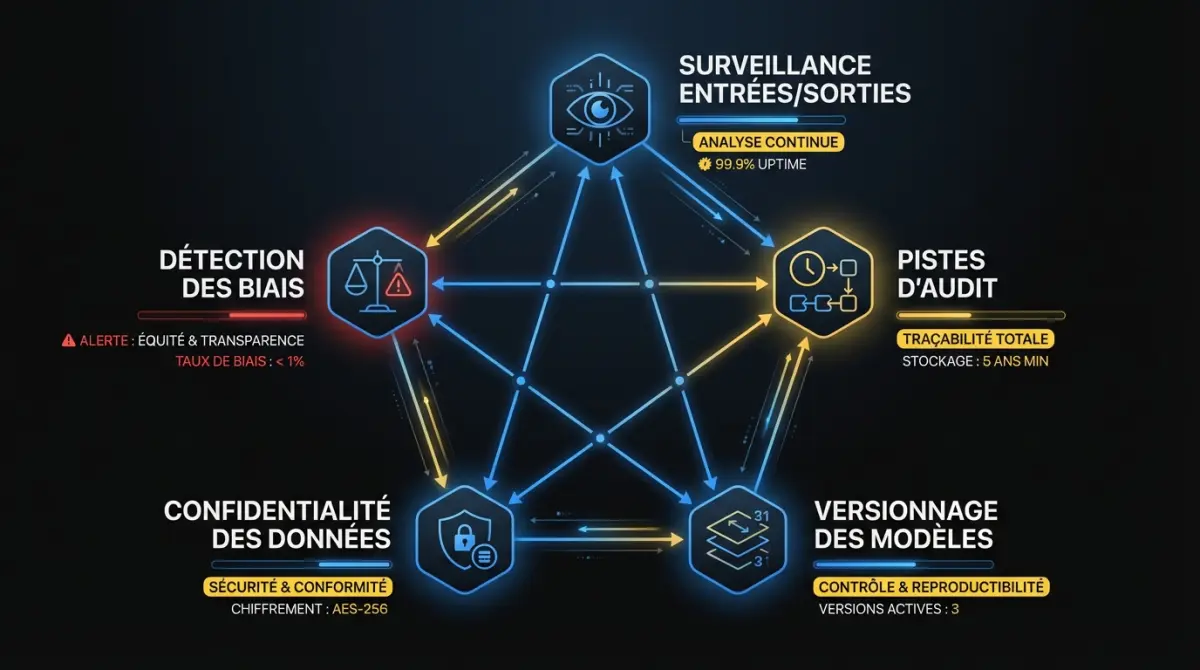

Enlevez le jargon réglementaire et la gouvernance IA pour une équipe produit se résume à cinq préoccupations.

Surveillance des entrées/sorties. Chaque fonctionnalité IA en production devrait journaliser ce qui entre et ce qui sort. Pas pour la conformité. Pour le débogage, l’assurance qualité et la réponse aux incidents. Quand un client signale une mauvaise recommandation, vous avez besoin de l’entrée exacte et de la sortie exacte pour diagnostiquer si le problème vient du prompt, du modèle, de la récupération de contexte ou d’une intégration d’outil. Les équipes qui sautent cette étape finissent par reproduire les bogues en devinant.

Détection des biais. Si votre fonctionnalité IA prend des décisions qui affectent les utilisateurs différemment selon des caractéristiques protégées, vous devez mesurer ça. Ça s’applique aux moteurs de recommandation, aux systèmes de notation, à la modération de contenu et à toute fonctionnalité qui classe, filtre ou catégorise des personnes. Pour les fonctionnalités qui traitent des documents ou génèrent du texte, les tests de biais sont moins critiques. Vous pouvez les reporter.

Pistes d’audit pour les décisions des agents. Si vous construisez des fonctionnalités IA agentiques, chaque appel d’outil, chaque étape de raisonnement et chaque point de décision a besoin d’une trace. Les agents qui opèrent sur plusieurs étapes et prennent des actions au nom des utilisateurs créent des lacunes de responsabilité si vous ne pouvez pas reconstituer leur chaîne de décisions après coup.

Confidentialité des données dans les pipelines IA. Où vont les données clients quand elles entrent dans votre pipeline IA? Est-ce qu’elles quittent votre infrastructure? Est-ce que le fournisseur de modèle les conserve pour l’entraînement? Si vous exploitez un système multi-locataire, est-ce que les données d’un client peuvent influencer les réponses pour un autre? Ce sont des questions d’architecture qui deviennent des questions juridiques rapidement si vous n’y répondez pas dès le départ.

Versionnage des modèles. Quand vous mettez à jour un modèle ou changez un gabarit de prompt, vous devez savoir quelle version a produit quelles sorties. Une plainte client de mardi dernier doit être traçable jusqu’à la configuration exacte du modèle qui tournait à ce moment-là. Épinglez vos versions de modèles. Étiquetez vos gabarits de prompts. Appliquez à votre pipeline IA la même discipline de versionnage que vous appliquez à votre code applicatif.

Quelles réglementations s’appliquent réellement à votre produit SaaS?

La réglementation rattrape l’IA plus vite que la plupart des équipes produit ne le réalisent. Vous n’avez pas besoin de devenir un expert réglementaire, mais vous devez savoir quelles règles s’appliquent à votre produit et ce qu’elles exigent.

Loi européenne sur l’IA (EU AI Act). C’est la réglementation IA la plus complète en vigueur. Elle utilise une approche par niveaux de risque. La plupart des produits SaaS B2B tombent dans les catégories « risque limité » ou « risque minimal », qui comportent des obligations plus légères. Si votre produit note ou classe des personnes (outils de recrutement, notation de crédit, assurance), vous êtes probablement dans le niveau « risque élevé ». Ça implique des évaluations de conformité obligatoires, des exigences de documentation et des obligations de surveillance humaine. Si votre produit génère du texte, des images ou des recommandations sans classer des personnes, vous êtes probablement en risque limité. L’obligation principale : la transparence. Les utilisateurs doivent savoir qu’ils interagissent avec une IA.

Lois américaines sur la vie privée. Il n’y a pas de loi fédérale sur l’IA aux États-Unis, mais les lois des États comblent le vide. Le CCPA de la Californie donne aux consommateurs des droits sur les renseignements personnels utilisés dans la prise de décision automatisée. La loi sur l’IA du Colorado, en vigueur en 2026, exige des déployeurs de « systèmes IA à haut risque » de mener des évaluations d’impact et d’informer les consommateurs. La Virginie, le Connecticut et le Texas ont des dispositions similaires. Le patron : si votre fonctionnalité IA prend des décisions conséquentes sur des personnes, vous avez besoin de documentation, d’avis et dans certains cas de mécanismes de retrait.

La LIAD du Canada. La Loi sur l’intelligence artificielle et les données chemine encore au Parlement. Le projet actuel crée des obligations pour les systèmes IA « à impact élevé » similaires au niveau de risque élevé de l’UE. Ce n’est pas encore une loi, mais si vous vendez à des entreprises canadiennes ou traitez des données d’utilisateurs canadiens, votre infrastructure de gouvernance devrait être prête à s’adapter. Construire des pistes d’audit et des évaluations d’impact maintenant vous évitera de courir quand la version finale sera adoptée.

Le message pratique pour les trois juridictions : transparence, documentation et surveillance humaine pour les décisions à enjeux élevés. Intégrez ça dans votre produit maintenant et vous serez conforme à l’essentiel de ce qui s’en vient.

Quels garde-fous sont nécessaires en production?

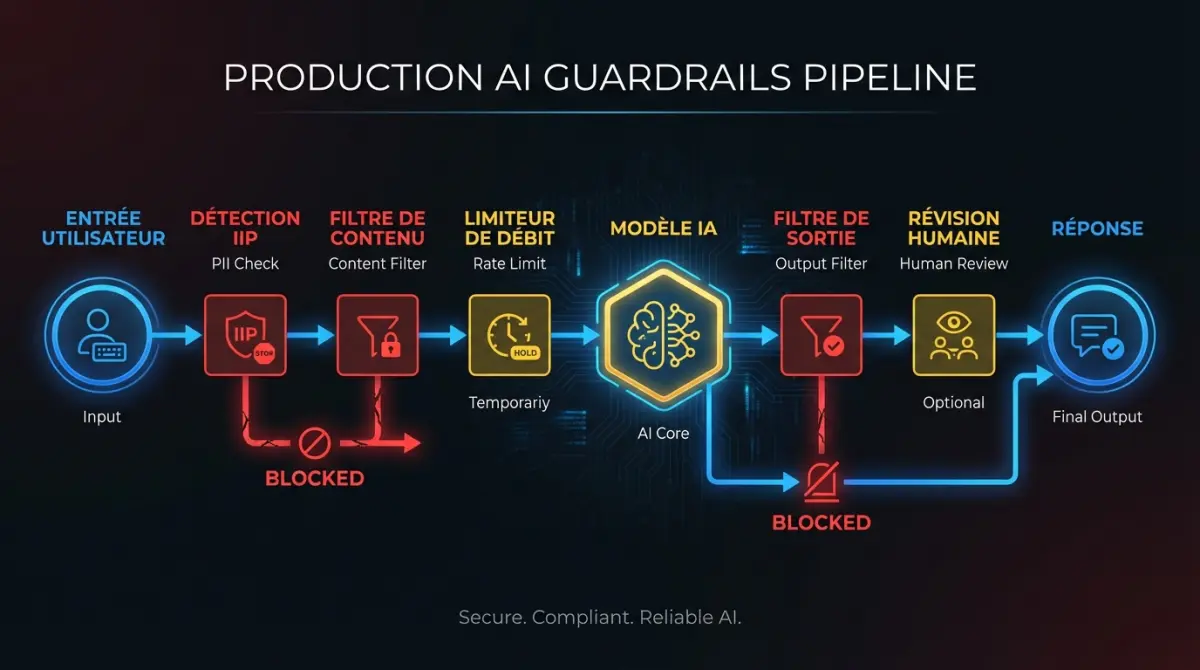

Les garde-fous sont les vérifications en temps réel qui empêchent vos fonctionnalités IA de faire quelque chose de nuisible, d’embarrassant ou de coûteux. Ils opèrent à la frontière entre votre système et le modèle, et entre le modèle et l’utilisateur.

Filtrage de contenu sur les sorties. Chaque réponse IA destinée aux clients devrait passer par un filtre qui attrape le contenu nuisible, les réponses hors sujet et le contenu qui contredit le domaine de votre produit. Ça n’a pas besoin d’être un appel de modèle séparé. La correspondance de patrons et la classification sur le texte de sortie attrapent la plupart des problèmes. Réservez l’évaluation coûteuse par modèle pour les fonctionnalités à enjeux élevés.

Détection des IIP dans les prompts et réponses. Les utilisateurs vont coller des données sensibles dans les fonctionnalités IA. Numéros d’assurance sociale, numéros de carte de crédit, identifiants internes. Votre système devrait détecter les IIP côté entrée avant qu’elles n’atteignent le modèle, et côté sortie avant qu’elles n’atteignent l’utilisateur. Des bibliothèques comme Microsoft Presidio gèrent la détection. Votre travail est de décider quoi faire quand des IIP sont trouvées : masquer, bloquer ou avertir.

Limitation de débit. Les fonctionnalités IA coûtent cher à exécuter et sont faciles à abuser. Des limites par utilisateur et par locataire protègent à la fois vos coûts d’infrastructure et vos clients contre les boucles d’agent incontrôlées. Un agent bien conçu qui entre dans un cycle infini d’appels d’outils peut brûler des milliers de dollars en coûts d’API en quelques minutes sans limitation de débit.

Humain dans la boucle pour les décisions à enjeux élevés. Toute action IA qui est coûteuse, irréversible ou qui affecte une autre personne devrait nécessiter une confirmation humaine avant exécution. Envoyer un courriel au nom d’un utilisateur. Modifier un dossier financier. Supprimer des données. Le seuil de « enjeux élevés » dépend de votre produit, mais le principe est universel : plus le coût d’une erreur est élevé, plus le point de contrôle humain est important.

Seuils de confiance pour les actions des agents. Si vos agents IA produisent des scores de confiance, utilisez-les. Fixez un seuil en dessous duquel l’agent s’en remet à un humain ou prend une action par défaut conservatrice. Un agent de classification qui est confiant à 60 % ne devrait pas prendre la même action qu’un qui est confiant à 95 %. Faites du routage basé sur la confiance une fonctionnalité de premier plan de votre architecture d’agent.

Comment aborder les tests de biais?

Les tests de biais ressemblent à une obligation de conformité. En pratique, c’est une discipline de qualité produit qui empêche votre IA de traiter les utilisateurs injustement d’une manière qui nuit à la confiance et crée une exposition juridique.

Quand les tests de biais sont essentiels. Toute fonctionnalité qui note, classe, filtre ou catégorise des personnes. Les moteurs de recommandation qui déterminent ce que voient les utilisateurs. Les outils de présélection qui déterminent qui obtient l’accès. Les algorithmes de tarification qui calculent des taux différents. Si la sortie de votre fonctionnalité IA affecte matériellement l’expérience ou les opportunités d’une personne, les tests de biais sont non négociables.

Quand les tests de biais sont moins prioritaires. Les fonctionnalités de génération de texte, les assistants de code, le résumé de documents, l’outillage interne qui n’affecte pas les utilisateurs finaux. Ces fonctionnalités peuvent avoir des problèmes de qualité, mais le biais démographique est rarement le risque principal. Concentrez vos investissements en tests de biais là où l’impact est le plus élevé.

Construction des ensembles d’évaluation. Créez des jeux de données de test qui incluent une variation démographique selon les dimensions pertinentes pour votre produit. Pour un outil de recrutement, ça veut dire des candidats avec des qualifications équivalentes mais des noms, genres et origines différents. Pour un produit de prêt, des profils financiers équivalents avec des signaux démographiques différents. L’ensemble d’évaluation doit être assez grand pour détecter des différences statistiquement significatives. Cinquante exemples par groupe démographique est un minimum. Deux cents, c’est mieux.

Métriques à suivre. La parité démographique mesure si les résultats sont distribués proportionnellement entre les groupes. L’égalité des chances mesure si les taux d’erreur sont cohérents entre les groupes. Un modèle avec 90 % de précision globale mais 95 % pour un groupe et 70 % pour un autre a un problème d’égalité des chances. Suivez les deux métriques. Rapportez-les à votre direction produit chaque trimestre.

Intégration des tests de biais dans le CI/CD. Exécutez les évaluations de biais à chaque mise à jour de modèle et chaque changement significatif de prompt. Traitez une régression dans les métriques d’équité de la même façon que vous traitez une régression dans les tests unitaires : bloquez le déploiement jusqu’à résolution.

Comment construire des pistes d’audit et de l’explicabilité?

Quelqu’un va demander pourquoi votre système a fait ce qu’il a fait. Un client, un régulateur, votre propre direction pendant une revue d’incident. Le moment de préparer la réponse à cette question, c’est avant qu’elle soit posée.

Journalisation des chaînes de raisonnement des agents. Pour les fonctionnalités agentiques, journalisez la séquence de décision complète : le prompt initial, chaque appel d’outil avec ses entrées et sorties, le raisonnement du modèle à chaque étape, et l’action finale. Stockez ces traces dans un format interrogeable. Quand quelqu’un demande « pourquoi le système a recommandé X », vous devriez pouvoir sortir la trace exacte et parcourir le raisonnement en moins de cinq minutes.

Stockage des séquences d’appels d’outils. Si vos agents IA interagissent avec des systèmes externes, journalisez chaque appel API que l’agent fait. Pas seulement les appels réussis. Les appels échoués, les nouvelles tentatives et les événements de délai d’attente sont là où vivent la plupart des bogues de production. Intégrez ces journaux à votre pile d’observabilité existante pour que le comportement des agents apparaisse aux côtés de vos métriques applicatives.

Rendre les décisions reproductibles. Épinglez vos versions de modèles. Stockez le gabarit de prompt exact utilisé pour chaque requête. Si vous utilisez la génération augmentée par récupération (RAG), journalisez quels documents ont été récupérés et leurs scores de pertinence. La reproductibilité compte pour le débogage et pour démontrer aux auditeurs que votre système se comporte de façon cohérente. Une requête du mois dernier devrait produire un résultat explicable quand vous la rejouez avec les mêmes entrées et la même version de modèle.

Politique de rétention. Décidez combien de temps vous conservez les journaux de décisions IA. Les exigences réglementaires varient. Le principe de minimisation des données du RGPD signifie que vous ne devriez pas garder les journaux indéfiniment. Un défaut raisonnable pour la plupart des produits SaaS : 90 jours pour les traces complètes, 12 mois pour les enregistrements d’audit sommaires. Ajustez selon votre industrie et votre environnement réglementaire.

À quoi ressemble la gouvernance des données dans les pipelines IA?

La gouvernance des données pour l’IA n’est pas une discipline séparée de votre gestion de données existante. C’est votre gouvernance de données existante appliquée à une nouvelle catégorie de flux de données qui bouge plus vite et a plus d’endroits où fuir.

Cartographiez vos flux de données. Documentez exactement quelles données clients entrent dans votre pipeline IA, où elles sont traitées et où elles sont stockées. Si vous utilisez une API de modèle tierce, vos données clients quittent votre infrastructure. Ça change vos ententes de traitement de données, votre posture de sécurité et potentiellement vos obligations de conformité. Dessinez le diagramme. Partagez-le avec votre équipe de sécurité.

Frontières des données d’entraînement. La plupart des API de modèles commerciaux (OpenAI, Anthropic, Google) offrent des options pour empêcher que les données clients soient utilisées pour l’entraînement du modèle. Activez ces options. Confirmez-les contractuellement. Vos clients vont demander, et « on pense que oui » n’est pas une réponse acceptable. Quand vous intégrez l’IA dans un produit existant, la gouvernance des données est une des premières décisions d’architecture à verrouiller.

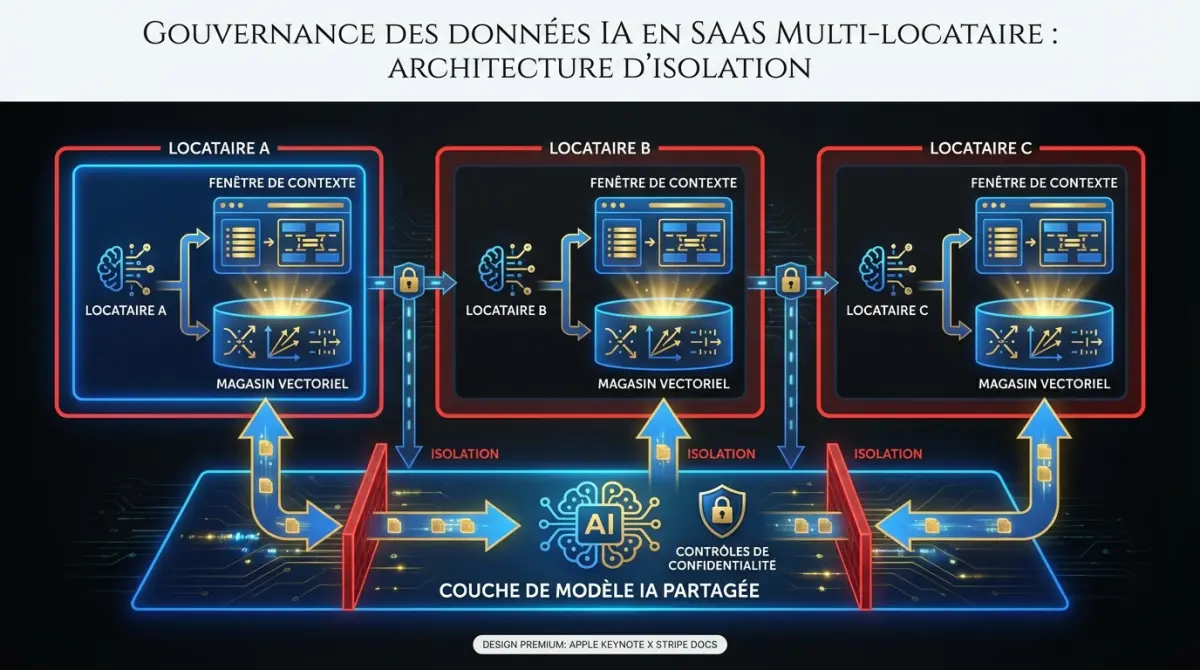

Isolation multi-locataire. Si vous exploitez un produit SaaS multi-locataire, assurez-vous que les données d’un client ne peuvent pas influencer les réponses IA pour un autre client. Ça implique des fenêtres de contexte séparées, des index de récupération séparés et pas de données de fine-tuning partagées. Dans les architectures RAG, l’isolation des locataires dans votre magasin vectoriel est aussi importante que l’isolation des locataires dans votre base de données applicative. Une fuite de données entre locataires via votre pipeline IA est identique à une fuite de données par tout autre chemin. Traitez-la avec la même rigueur.

Résidence des données. Certains clients exigent que leurs données restent dans des régions géographiques spécifiques. Si votre pipeline IA achemine les données via des fournisseurs de modèles dans d’autres juridictions, vous avez un problème de résidence. Confirmez où votre inférence de modèle s’exécute. Considérez des déploiements de modèles auto-hébergés ou régionaux pour les clients avec des exigences strictes de résidence.

Comment minimiser la taxe de gouvernance sur la vélocité?

Chaque mesure de gouvernance ajoute de la friction à votre processus de développement. La journalisation ralentit les réponses. Les tests de biais ajoutent du temps à votre cycle de mise en production. Le filtrage de contenu ajoute de la latence à chaque requête. C’est réel, et les équipes qui ignorent le coût finissent par abandonner soit la gouvernance, soit la vélocité.

L’erreur que font la plupart des équipes est la pensée binaire : soit ne rien faire (ce qui marche jusqu’au jour où ça ne marche plus), soit implémenter toutes les mesures de gouvernance dès le premier jour (ce qui vous ralentit à l’extrême).

Adaptez la gouvernance à votre profil de risque. Un outil interne qui résume les notes de réunion a besoin de journalisation des entrées/sorties et d’un filtrage de contenu de base. C’est tout. Un agent destiné aux clients qui prend des actions au nom des utilisateurs a besoin de la pile complète : pistes d’audit, tests de biais, détection d’IIP, seuils de confiance, points de contrôle humains.

Classifiez vos fonctionnalités IA par niveau de risque. Empruntez le cadre de la Loi européenne sur l’IA même si vous n’y êtes pas assujetti. Assignez chaque fonctionnalité à un niveau : risque minimal (outils internes, génération de texte), risque limité (recommandations destinées aux clients, génération de contenu), risque élevé (notation, classement ou décisions affectant des personnes). Appliquez la gouvernance proportionnellement.

Automatisez ce que vous pouvez. La détection d’IIP, le filtrage de contenu et la journalisation d’audit devraient être de l’infrastructure, pas un processus manuel. Intégrez-les dans votre couche middleware IA pour que chaque fonctionnalité obtienne une gouvernance de base sans que les équipes fonctionnalités fassent du travail supplémentaire. Les tests de biais devraient s’exécuter dans le CI/CD, pas dans une revue manuelle trimestrielle.

Budgétez pour ça. La gouvernance ajoute 10 à 20 % de surcharge au développement de fonctionnalités IA, selon le niveau de risque. C’est le prix pour livrer des fonctionnalités IA qui n’explosent pas. Intégrez ça dans votre planification de sprint et votre budget d’infrastructure. Les équipes qui traitent la gouvernance comme du « travail supplémentaire » la reportent indéfiniment. Les équipes qui budgétisent pour la livrent.

Les entreprises qui réussissent n’ont pas de plus grandes équipes de gouvernance. Elles ont une meilleure infrastructure. Les vérifications de gouvernance qui s’exécutent automatiquement sur chaque requête sont moins chères et plus fiables que les revues de gouvernance qui se font manuellement avant chaque mise en production. Investissez dans l’infrastructure tôt. Ça se rembourse la première fois qu’un client demande comment votre IA prend ses décisions et que vous pouvez répondre en cinq minutes au lieu de cinq jours.

FAQ

Quel est le minimum de gouvernance pour une fonctionnalité IA à faible risque?

Journalisation des entrées/sorties et filtrage de contenu de base. Si la fonctionnalité génère du texte ou des recommandations pour usage interne, ces deux contrôles couvrent vos risques principaux. Ajoutez la détection d’IIP si les utilisateurs peuvent entrer du texte libre. Vous n’avez pas besoin de tests de biais ou de pistes d’audit complètes pour les fonctionnalités à risque minimal.

Combien la gouvernance IA ralentit-elle le développement?

Prévoyez 10 à 20 % de surcharge sur le développement de fonctionnalités IA. La majeure partie de ce coût est initiale. Une fois que vous intégrez la gouvernance dans votre couche middleware IA (journalisation, détection d’IIP, filtrage de contenu comme infrastructure partagée), chaque fonctionnalité obtient une couverture de base avec un effort minimal supplémentaire. Le coût continu vient des tests de biais et de la maintenance des pistes d’audit pour les fonctionnalités à risque élevé.

Les entreprises SaaS canadiennes doivent-elles se conformer à la Loi européenne sur l’IA?

Si vous vendez à des clients de l’UE ou traitez des données d’utilisateurs de l’UE, oui. La Loi européenne sur l’IA s’applique en fonction de l’endroit où se trouvent vos utilisateurs, pas de l’endroit où votre entreprise a son siège social. La plupart des produits SaaS B2B tombent dans les niveaux de risque limité ou minimal, qui exigent la transparence (informer les utilisateurs qu’ils interagissent avec une IA) et une documentation de base. Les produits à risque élevé (notation, classement ou classification de personnes) font face à des exigences plus strictes.

Intégrer la gouvernance dans vos fonctionnalités IA est un investissement qui se compose. Plus vous commencez tôt, moins c’est douloureux. Si votre équipe a besoin d’aide pour concevoir une infrastructure de gouvernance IA ou livrer des fonctionnalités IA avec les bons garde-fous, contactez-nous. Nous travaillons avec des entreprises SaaS pour bâtir des systèmes IA qui tiennent en production.