Point clé

Les métriques produit standards comme les DAU et le NPS ne captent pas la valeur des fonctionnalités IA. Mesurez le taux de réussite des tâches, le taux d'escalade humaine, l'acceptation des sorties et l'impact commercial pour savoir quelles fonctionnalités IA méritent un investissement continu.

Chaque équipe produit avec qui on travaille a livré au moins une fonctionnalité IA dans la dernière année. La plupart peuvent vous dire combien d’utilisateurs l’ont essayée. Très peu peuvent vous dire si elle a fonctionné.

“On a ajouté de l’IA” n’est pas une mesure de succès. Un pic d’utilisation la semaine après le lancement non plus. Les équipes qui construisent une valeur IA durable mesurent des choses précises, et elles les mesurent différemment des fonctionnalités traditionnelles.

Voici un cadre pour faire exactement ça. Il couvre les métriques qui comptent, celles qui ne comptent pas, et comment bâtir un système d’évaluation qui vous dit si votre fonctionnalité IA mérite sa place dans le produit.

Pourquoi les métriques produit standards passent-elles à côté?

Votre stack analytique existant suit les utilisateurs actifs quotidiens, la durée des sessions, le NPS et l’adoption des fonctionnalités. Ces métriques vous disent si les gens utilisent votre produit. Elles ne vous disent pas si une fonctionnalité IA spécifique livre de la valeur.

Prenez une équipe qui livre une fonctionnalité de résumé généré par IA dans son outil de gestion de projets. Les DAU restent stables. Le NPS monte de deux points. L’adoption atteint 40% le premier mois. La direction appelle ça une victoire.

Mais personne n’a demandé : les résumés sont-ils exacts? Les utilisateurs les lisent-ils et passent-ils à autre chose, ou vont-ils vérifier le matériel source quand même? Les utilisateurs qui se fient aux résumés prennent-ils de moins bonnes décisions parce que l’IA a manqué du contexte?

Les métriques produit standards vous disent que les gens ont cliqué sur le bouton. Elles ne vous disent pas si cliquer en valait la peine. Pour les fonctionnalités IA, vous avez besoin de métriques qui captent la qualité des sorties, la confiance des utilisateurs et l’impact commercial réel en plus de l’adoption.

Quelles métriques de complétion de tâches devriez-vous suivre?

Celles-ci vous disent si l’IA fait ce que les utilisateurs attendent d’elle.

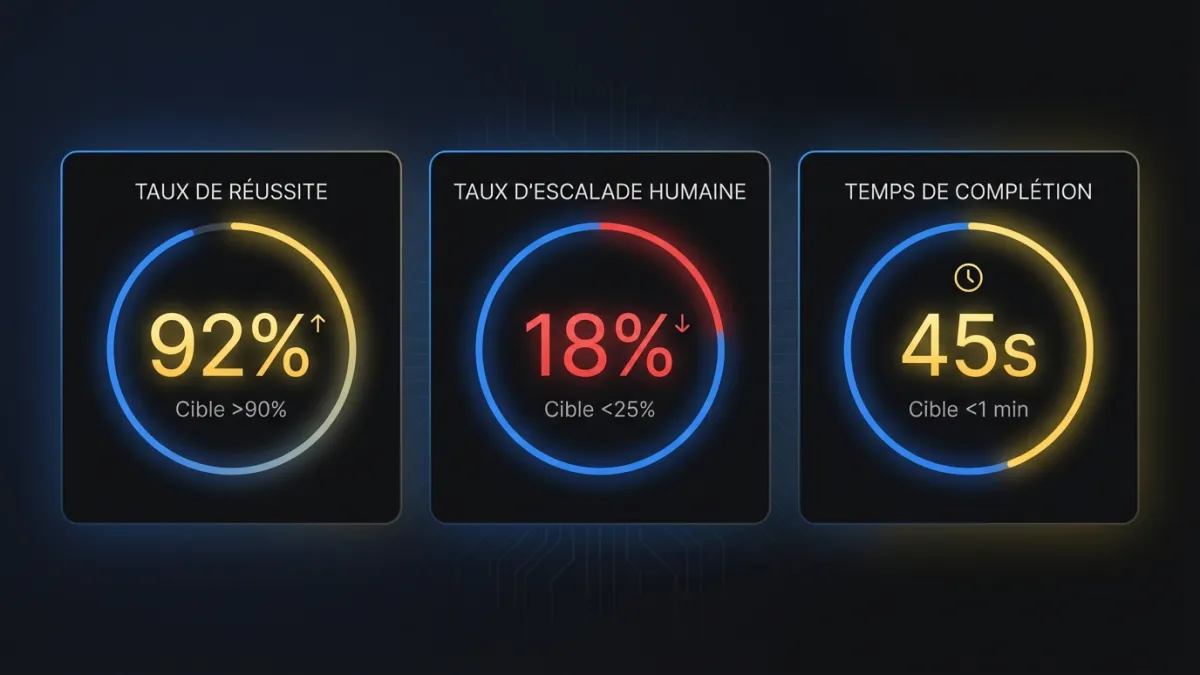

Taux de réussite des tâches. Le pourcentage de fois que l’IA complète la tâche initiée par l’utilisateur. Si un utilisateur demande à votre fonctionnalité IA de générer un résumé de rapport, l’a-t-elle produit? Ça semble basique, mais beaucoup d’équipes ne le suivent pas. Les échecs incluent les délais d’attente, les états d’erreur, les refus et les sorties tellement hors cible que l’utilisateur les abandonne immédiatement. Une fonctionnalité IA saine devrait être au-dessus de 90%. En dessous de 80%, vous avez un problème de fiabilité qui tuera l’adoption peu importe la qualité des sorties.

Taux d’escalade humaine. La fréquence à laquelle les utilisateurs remplacent, modifient substantiellement ou abandonnent la sortie IA pour faire la tâche manuellement. C’est la métrique la plus honnête pour la qualité d’une fonctionnalité IA. Si 60% des utilisateurs ignorent la sortie IA et le font eux-mêmes, la fonctionnalité est décorative. Suivez-la chaque semaine. Un bon objectif est sous 25% d’escalade pour les fonctionnalités en ligne depuis plus de 90 jours.

Temps de complétion. Mesurez la même tâche avec et sans le parcours IA. Si votre fonctionnalité IA ne fait pas gagner un temps mesurable, elle doit livrer de la valeur dans une autre dimension (précision, cohérence, réduction de la charge cognitive) ou elle ne fait pas son travail. Soyez précis : “La catégorisation de factures assistée par IA prend 12 secondes par item contre 34 secondes en manuel” est une métrique sur laquelle vous pouvez bâtir un cas d’affaires.

Comment mesurer la qualité des sorties IA?

La complétion de tâches vous dit que l’IA a produit quelque chose. Les métriques de qualité vous disent si ce quelque chose était bon.

Taux d’acceptation des sorties. Le pourcentage de sorties générées par IA que les utilisateurs gardent sans modification. Pour la génération de texte, ça veut dire que l’utilisateur clique “accepter” sans modifier. Pour la classification, ça veut dire que l’étiquette de l’IA correspond à ce que l’utilisateur aurait choisi. Un bon taux d’acceptation dépend de la tâche. Pour la plupart des fonctionnalités de génération de contenu, 40-50% d’acceptation sans modification est solide. Au-dessus de 70%, c’est excellent.

Distance d’édition. Quand les utilisateurs modifient la sortie IA, combien changent-ils? Un utilisateur qui corrige une faute de frappe est très différent d’un qui réécrit trois paragraphes. Mesurez la distance d’édition comme pourcentage de la sortie originale. Si votre médiane est au-dessus de 50%, les utilisateurs traitent l’IA comme un générateur de brouillon au mieux. Ça peut être acceptable pour certains cas d’utilisation, mais vous devriez connaître le chiffre et suivre la tendance.

Taux d’erreur par catégorie. Toutes les erreurs IA ne sont pas égales. Une fonctionnalité de résumé qui utilise occasionnellement une formulation maladroite est différente d’une qui énonce des chiffres incorrects. Catégorisez vos erreurs : erreurs factuelles, inadéquations de ton, contexte manquant, hallucinations, problèmes de formatage. Suivez chaque catégorie séparément. Ces données vous disent où concentrer les améliorations du modèle. Elles vous aident aussi à décider si certains types d’erreurs nécessitent des garde-fous, des étapes de révision humaine ou des approches architecturales différentes.

Les utilisateurs font-ils vraiment confiance à la fonctionnalité IA?

Les métriques de qualité vous disent si l’IA est bonne. Les métriques de confiance vous disent si les utilisateurs croient que l’IA est bonne. Ce sont deux choses différentes. Une fonctionnalité peut produire d’excellentes sorties et quand même échouer si les utilisateurs ne lui font pas assez confiance pour s’y fier.

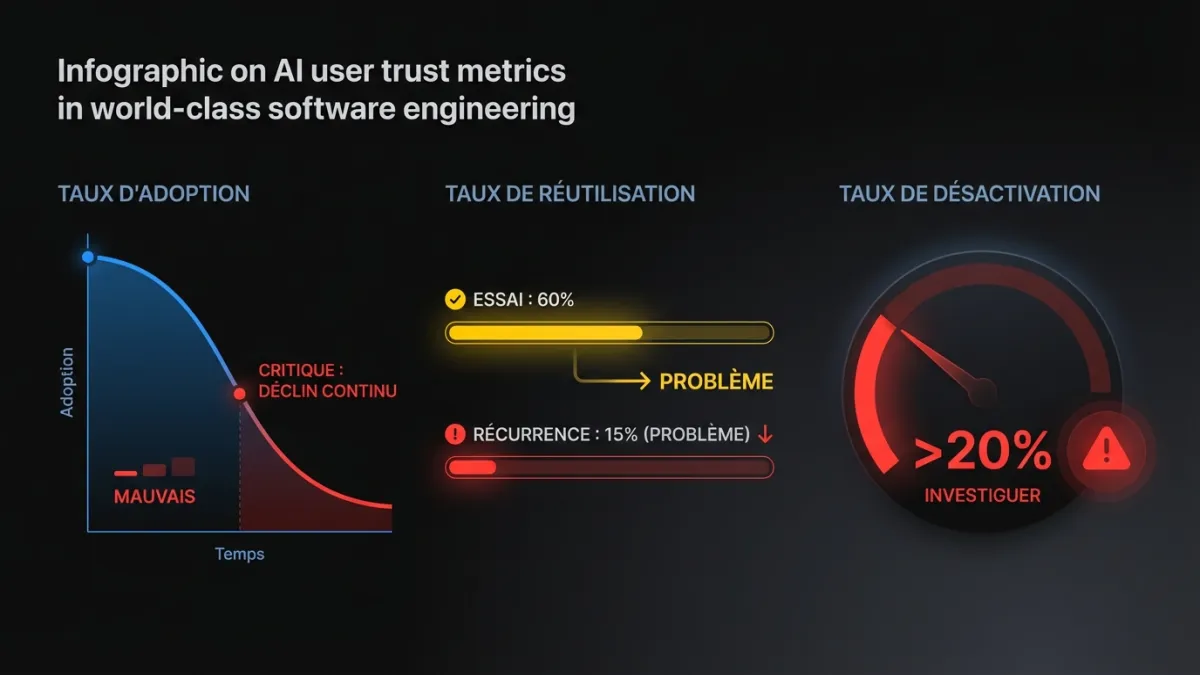

Taux d’adoption dans le temps. Pas juste “40% l’ont essayé le premier mois.” Suivez la courbe d’adoption hebdomadaire ou mensuelle. De nouveaux utilisateurs découvrent-ils et utilisent-ils la fonctionnalité? L’adoption est-elle en croissance, en plateau ou en déclin? Une fonctionnalité qui monte en flèche au lancement et chute sur 90 jours a un problème de confiance ou de qualité que l’enthousiasme initial a masqué.

Taux de réutilisation. Le pourcentage d’utilisateurs qui ont utilisé la fonctionnalité IA une fois et l’ont réutilisée dans les 7, 14 ou 30 jours. C’est plus révélateur que l’adoption brute. Une fonctionnalité avec 60% d’essai mais 15% de réutilisation déçoit au premier contact. Comparez avec les taux de réutilisation de vos fonctionnalités principales. Les fonctionnalités IA devraient viser à les égaler ou les dépasser.

Taux de désactivation. Si votre fonctionnalité IA offre une option de retrait ou de désactivation, suivez combien d’utilisateurs la désactivent. Plus important encore, suivez quand ils la désactivent. Les utilisateurs qui désactivent après une session ont eu une mauvaise première expérience. Les utilisateurs qui désactivent après trois mois ont peut-être une plainte plus nuancée qui mérite investigation. Si le taux de désactivation dépasse 20%, faites des entrevues utilisateurs avant d’investir davantage.

Quelles métriques d’impact commercial comptent le plus?

Celles-ci connectent la performance des fonctionnalités IA aux chiffres qui importent à votre directeur financier.

Revenu par interaction assistée par IA. Pour les fonctionnalités dans le parcours de conversion ou de transaction, comparez le revenu des flux assistés par IA aux flux sans IA. Une recherche de produit améliorée par IA qui augmente la valeur moyenne des commandes de 8% a un montant en dollars clair. C’est la métrique qui justifie l’investissement continu.

Taux de déflection des tickets de support. Comptez les tickets de support dans les catégories que votre fonctionnalité IA adresse. Si vous avez livré un centre d’aide alimenté par IA, suivez les tickets “comment faire” avant et après. Si le nombre baisse, vous pouvez calculer les économies par ticket détourné (typiquement 5 à 25$ par ticket selon votre modèle de support).

Temps économisé par utilisateur par semaine. Agrégez les améliorations de temps de complétion à travers toutes les tâches assistées par IA pour un utilisateur moyen. “Nos fonctionnalités IA font économiser 47 minutes par semaine à l’utilisateur médian” est un argument de rétention, un argument de tarification et un argument de différenciation concurrentielle en un seul chiffre.

Taux de conversion des flux améliorés par IA. Pour les flux d’intégration, d’inscription ou d’achat qui incluent des étapes IA, faites la comparaison. La version améliorée par IA convertit-elle mieux? De combien? C’est là que l’intégration stratégique de l’IA prouve sa valeur en termes de pipeline.

Quelles métriques devriez-vous arrêter de suivre?

Trois métriques apparaissent régulièrement dans les tableaux de bord de fonctionnalités IA et ne vous disent presque rien.

Volume brut d’appels API. Une utilisation API élevée ne signifie pas une valeur élevée. Une fonctionnalité mal conçue qui fait cinq appels pour produire une sortie aura un volume API impressionnant et une expérience utilisateur terrible. Suivez les résultats, pas l’activité d’infrastructure.

Précision du modèle en isolation. Votre modèle atteint 94% de précision sur votre jeu de test. Les utilisateurs rapportent que la fonctionnalité “se trompe tout le temps.” La précision en labo mesure la performance sur des données organisées. La précision en production inclut les cas limites, les entrées adversaires, les déplacements de distribution et les attentes des utilisateurs que votre jeu de test n’a pas anticipées. Mesurez la précision en production en suivant l’acceptation des sorties et les taux d’erreur dans le produit en ligne. Le chiffre du jeu de test est une métrique d’ingénierie interne, pas une métrique de succès produit.

“Interactions IA” comme chiffre isolé. “Les utilisateurs ont eu 2,3 millions d’interactions IA ce trimestre” ne veut rien dire sans contexte. Ces interactions étaient-elles réussies? Les utilisateurs ont-ils obtenu ce dont ils avaient besoin? Une fonctionnalité de recherche où les utilisateurs cherchent cinq fois pour trouver une réponse a un volume d’interactions élevé et une expérience terrible. Associez les comptes d’interactions aux taux de succès ou ne les rapportez pas du tout.

Comment bâtir un cadre d’évaluation?

Choisir les bonnes métriques est la moitié du problème. L’autre moitié est de bâtir un système qui produit des données fiables dans le temps.

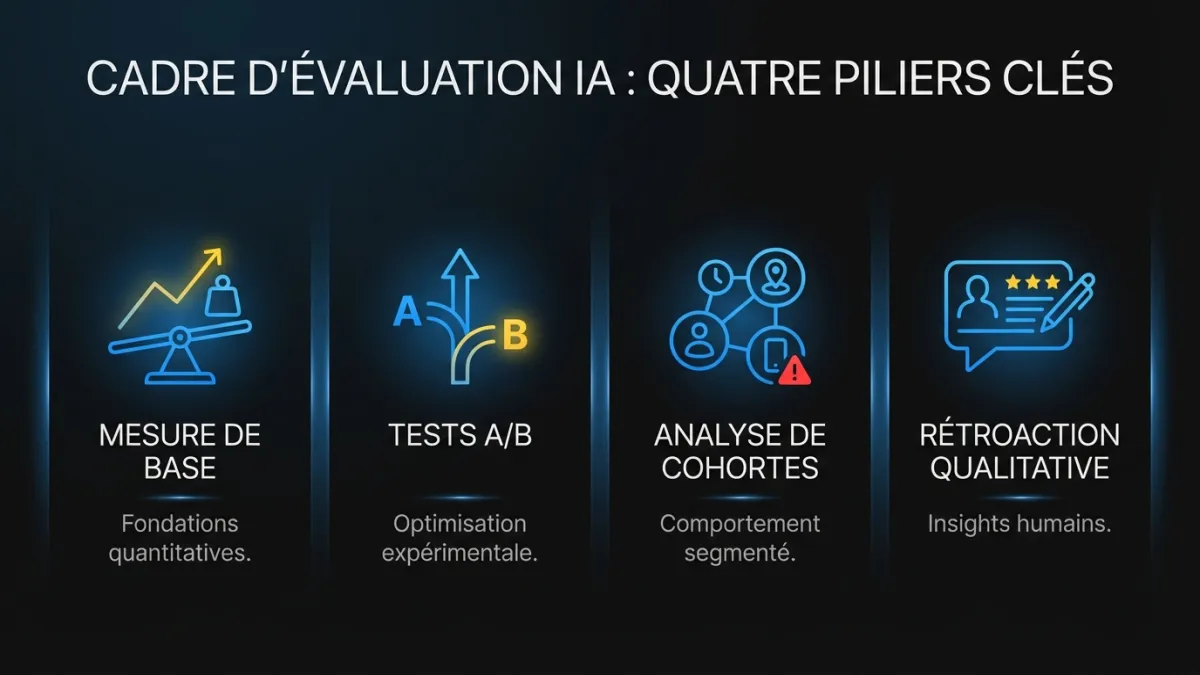

Mesure de base avant le lancement. Mesurez les métriques qui vous importent avant que la fonctionnalité IA soit en ligne. Temps de complétion, taux d’erreur, volumes de tickets de support, taux de conversion. Sans base de référence, chaque chiffre post-lancement est sans ancrage. Vous ne pouvez pas prouver une amélioration si vous n’avez pas mesuré le point de départ.

Tests A/B avec un vrai groupe contrôle. Montrez la fonctionnalité IA à un sous-ensemble aléatoire d’utilisateurs. Gardez un groupe contrôle sur la version sans IA. Comparez les résultats après 30, 60 et 90 jours. C’est la seule façon d’isoler l’impact de la fonctionnalité IA des autres changements produit, effets saisonniers et changements de comportement des utilisateurs. Les équipes qui sautent les tests A/B et comparent juste les périodes “avant” et “après” mesurent le temps, pas la causalité.

Analyse de cohortes pour la rétention. Les utilisateurs qui adoptent la fonctionnalité IA retiennent-ils mieux à 90 jours que ceux qui ne l’adoptent pas? C’est le signal le plus fort de la valeur à long terme d’une fonctionnalité IA. Si les utilisateurs IA désabonnent au même rythme que les utilisateurs sans IA, la fonctionnalité ne crée pas d’adhérence. S’ils retiennent 10-15% mieux, vous avez construit quelque chose qui change l’équation de valeur du produit.

Boucles de rétroaction qualitative. Mettez un pouce en haut/pouce en bas sur chaque sortie IA. Ajoutez un champ texte optionnel pour “qu’est-ce qui n’a pas fonctionné” sur les évaluations négatives. Faites des entrevues utilisateurs mensuelles avec les grands utilisateurs IA et ceux qui ont essayé la fonctionnalité et arrêté. Les données quantitatives vous disent ce qui se passe. Les données qualitatives vous disent pourquoi. Vous avez besoin des deux.

Exemple concret : recherche alimentée par IA

Une entreprise SaaS B2B livre une fonctionnalité de recherche alimentée par IA qui remplace la recherche par mots-clés par la compréhension sémantique. Voici à quoi ressemble la mesure.

Base de référence (recherche pré-IA) :

- 2,3 recherches par tâche (les utilisateurs cherchaient plusieurs fois pour trouver ce dont ils avaient besoin)

- 45 secondes en moyenne de la première recherche au clic sur un résultat

- 12% des sessions de recherche se terminaient sans que l’utilisateur clique sur un résultat

- 340 tickets de support par mois dans la catégorie “je ne trouve pas X”

Post-lancement (90 jours, groupe recherche IA en test A/B) :

- 1,4 recherches par tâche (réduction de 39%)

- 18 secondes en moyenne pour obtenir un résultat (60% plus rapide)

- 4% des sessions sans clic sur un résultat (contre 12%)

- Satisfaction rapportée par les utilisateurs en hausse de 22% (sondage in-app)

- Tickets “je ne trouve pas X” en baisse de 34% (de 340 à 224 par mois)

- Les utilisateurs de la cohorte recherche IA retiennent 8% mieux à 90 jours

Chacun de ces chiffres raconte une histoire spécifique. Moins de recherches par tâche signifie que l’IA comprend mieux l’intention. Un temps de résultat plus rapide signifie moins de friction. Un taux de non-clic plus bas signifie des résultats plus pertinents. La réduction des tickets de support se traduit par environ 2 900$/mois d’économies à 25$ par ticket. L’amélioration de la rétention a des implications de revenus composées.

C’est ça une mesure utile. Pas “l’utilisation de la recherche a augmenté de 40%.”

Quand faut-il abandonner une fonctionnalité IA?

Toutes les fonctionnalités IA ne méritent pas de survivre. Ces signaux indiquent qu’il est temps de couper vos pertes.

L’adoption plafonne sous 20% après 60 jours. Si 80% de vos utilisateurs ont vu la fonctionnalité et choisi de ne pas l’utiliser deux mois après le lancement, la fonctionnalité a un problème de valeur fondamental. De petits ajustements UX ne le régleront pas. La capacité sous-jacente a besoin d’une mise à niveau significative ou le cas d’utilisation n’est pas assez fort.

La distance d’édition reste au-dessus de 60%. Les utilisateurs qui réécrivent la majorité de la sortie IA font un travail en double : lire la version de l’IA puis produire la leur. Ils iraient plus vite sans la fonctionnalité. Si ce chiffre ne s’améliore pas après deux itérations de modèle, la tâche n’est peut-être pas bien adaptée à l’assistance IA avec la technologie actuelle.

La fonctionnalité augmente les tickets de support au lieu de les réduire. Ça arrive plus souvent que les équipes ne l’admettent. Une fonctionnalité IA qui confond les utilisateurs, produit des résultats incohérents ou se comporte de façon imprévisible génère une nouvelle catégorie de demandes de support. Si vous dépensez plus à supporter la fonctionnalité IA que ce que vous avez économisé en la livrant, le calcul ne fonctionne pas.

Aucun impact commercial mesurable après 90 jours. Si la fonctionnalité ne fait bouger aucune métrique commerciale, elle coûte du temps d’ingénierie, du calcul et un fardeau de maintenance pour zéro retour. Les déploiements en entreprise ont particulièrement besoin d’échéanciers ROI clairs. Le sentiment et l’engagement sont des indicateurs avancés, mais ils doivent se convertir en résultats commerciaux dans un trimestre.

La partie la plus difficile du développement de produits IA n’est pas de livrer des fonctionnalités. C’est de savoir lesquelles garder. Un cadre de mesure discipliné vous donne les données pour faire cet appel avec confiance plutôt qu’avec l’intuition.

Foire aux questions

Quel est le KPI le plus important pour les fonctionnalités IA?

Le taux d’escalade humaine. Il vous dit à quelle fréquence les utilisateurs abandonnent la sortie IA pour faire la tâche manuellement. Si la plupart des utilisateurs ignorent ce que l’IA produit, aucune donnée d’adoption ou d’engagement n’a d’importance. Suivez-le chaque semaine et visez sous 25% pour les fonctionnalités en ligne depuis plus de 90 jours.

Combien de temps faut-il attendre avant d’évaluer une fonctionnalité IA?

Donnez-lui 90 jours avec un vrai test A/B et un groupe contrôle. Les 30 premiers jours reflètent la nouveauté, pas la valeur. À 90 jours, vous aurez assez de données sur la réutilisation, les taux d’escalade et l’impact commercial pour prendre une vraie décision sur l’investissement futur, l’itération ou l’abandon de la fonctionnalité.

Faut-il suivre la précision du modèle IA comme métrique produit?

Non. La précision en labo sur un jeu de test ne reflète pas la performance en production. Les utilisateurs rencontrent des cas limites, des entrées inattendues et des changements de distribution que vos données de test n’incluaient pas. Suivez plutôt le taux d’acceptation des sorties et le taux d’erreur par catégorie dans le produit en ligne. Ces chiffres vous disent ce que les utilisateurs vivent réellement.

Prêt à construire des fonctionnalités IA qui livrent des résultats mesurables? Parlez à notre équipe pour intégrer l’IA dans votre produit avec une stratégie de mesure claire dès le premier jour.